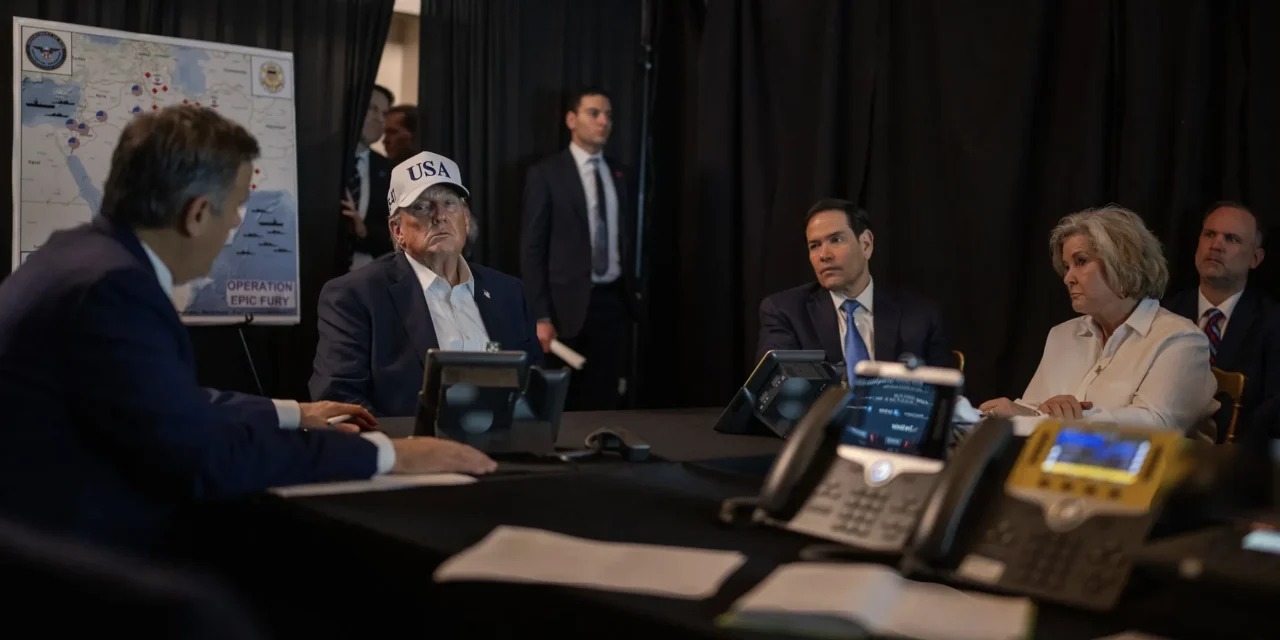

L’azienda Anthropic fondata da italo-americani non voleva l’uso per scopi letali del suo prodotto. Trump l’ha quindi bannata dai contratti col Pentagono, ma poi il suo software “Claude” è stato di fatto utilizzato nel teatro di guerra iraniano.

Poche ore prima degli attacchi in Iran, la Casa Bianca ordina alle agenzie federali di smettere con un’IA; poi emerge che lo stesso apparato militare l’ha impiegata per analisi, obiettivi e simulazioni. Il risultato è un corto circuito: la politica fa scena con i divieti, la sicurezza nazionale lavora con gli algoritmi. E la guerra, così, diventa più facile da decidere e più difficile da fermare.

C’è un dettaglio che, più della cronaca militare, racconta il nostro tempo: la guerra comincia e, poche ore prima, un presidente firma un divieto “immediato” contro un fornitore di intelligenza artificiale; poi, nello stesso teatro operativo, quella stessa IA compare comunque nella catena decisionale. Non è solo una contraddizione politica. È l’immagine nitida di un passaggio di epoca: l’algoritmo non è più un accessorio, ma un’infrastruttura. E quando l’infrastruttura entra nel dispositivo bellico, il confine tra “strumento” e “regola” diventa inquietantemente sottile.

La vicenda che oppone l’amministrazione Trump ad Anthropic – formalizzata il 27 febbraio 2026 e resa pubblica sui canali social presidenziali – nasce da una frizione classica, quasi ottocentesca, ma applicata a un oggetto nuovissimo: chi stabilisce le condizioni d’uso di una tecnologia che, di fatto, può diventare un moltiplicatore di potenza? Da una parte lo Stato, che in nome della sicurezza nazionale pretende accesso ampio, senza “lacci” contrattuali; dall’altra un’azienda che teme l’effetto-valanga: dalla valutazione d’intelligence alla sorveglianza, dalla simulazione di scenari alla delega operativa, fino all’orizzonte – oggi ancora politicamente conteso – delle armi autonome.

Il punto non è stabilire chi abbia “ragione” in astratto. Il punto è che, appena la contesa si fa dura, il linguaggio scivola in una teologia rovesciata: l’IA come “purezza” o “impurità” ideologica, come “woke” o “anti-woke”, come fede o eresia. Il dibattito etico viene risucchiato dalla polarizzazione, e l’argomento più fragile diventa il più rumoroso: non “cosa è lecito e cosa no”, ma “chi comanda”. In questo clima, il divieto presidenziale è insieme atto politico e messaggio disciplinare al mercato: se non accetti l’uso che lo Stato vuole, lo Stato cambia fornitore.

Ed eccolo, il mercato che cambia fornitore. Nel giro di giorni, il Pentagono stringe un’intesa con OpenAI, presentata come più “blindata” da paletti: niente impiego intenzionale per sorveglianza interna su larga scala, niente controllo di sistemi d’arma autonomi senza supervisione umana, salvaguardie gestite in ambienti protetti. Sono linee rosse che suonano rassicuranti, e tuttavia rivelano il problema: se servono “linee rosse”, allora l’uso militare non è un’eccezione, ma un destino già in corso.

A questo punto la domanda non è tecnica ma antropologica: che cosa accade quando l’“accelerazione” diventa dottrina di governo? L’argomento a favore è noto: velocità, scala, previsione, riduzione dell’incertezza. Ma la guerra non è un foglio di calcolo. È attrito, errore, ambiguità morale, responsabilità. Se l’IA entra nella pianificazione come motore di scenari e selezione di obiettivi, il rischio non è soltanto l’incidente. È la trasformazione del giudizio: dalla prudenza alla probabilità, dalla deliberazione alla performance, dalla responsabilità personale alla delega procedurale.

Non sorprende, allora, che mentre Washington discute di contratti e “supply chain risk”, a Ginevra torni l’urgenza di regole sulle armi autonome letali, dopo anni di stallo: un testo non vincolante, forse, ma la consapevolezza che l’attuale quadro non basta a colmare i vuoti di accountability quando l’autonomia cresce. E non sorprende nemmeno che la Santa Sede, con Mons. Daniel Pacho, rilanci l’allarme contro la militarizzazione dell’IA e degli “spazi emergenti”, chiedendo verifiche e accordi concreti di disarmo: perché il punto, per la Chiesa, non è demonizzare la tecnica, ma impedire che l’assenza dell’umano diventi norma nelle decisioni di forza.

C’è infine un paradosso quasi ironico, che però è la chiave della storia: il divieto “immediato” accompagnato da una fase di eliminazione graduale di sei mesi. È l’ammissione implicita che queste tecnologie non si spengono come una lampadina. Sono innestate nei flussi di lavoro, nei sistemi, nelle abitudini decisionali. In altri termini: la politica può cambiare slogan in un’ora; l’infrastruttura cambia in mesi, e a volte non cambia affatto, ma migra altrove.

Ecco perché la fantascienza – che pure aveva immaginato supercomputer padroni del mondo – oggi non basta più come metafora. Non ci serve un’IA “cattiva” per avere un futuro pericoloso. Ci basta un’IA “utile”, normalizzata, integrata, premiata per la rapidità. Il rischio non è l’autocoscienza delle macchine; è la nostra assuefazione alla loro efficienza, fino a considerare “intralciante” ciò che rende umano il potere: il dubbio, la proporzione, la compassione, la responsabilità.

Se una lezione si può trarre da questi giorni – tra ordini esecutivi, contratti, ritorsioni e negoziati internazionali – è che la domanda decisiva non è “chi avrà l’IA più forte”, ma quale civiltà vogliamo che governi la forza. Perché una guerra combattuta “meglio” dai modelli rischia di essere una guerra combattuta “più facilmente”. E nulla, più della facilità, rende la violenza plausibile.